Что случилось?

Во вторник мир получил еще причину переживать: за безопасность от роботов и за толерантность этих самых роботов. В США, и конкретно в Джорджии провели исследование, как беспилотные автомобили реагируют на пешеходов с разным цветом кожи. Тестировщики выяснили, что да: чем вы светлее, тем больше шансов, что управляемая алгоритмом машина заметит и пощадит вас.

Авторы проводили исследование поэтапно.

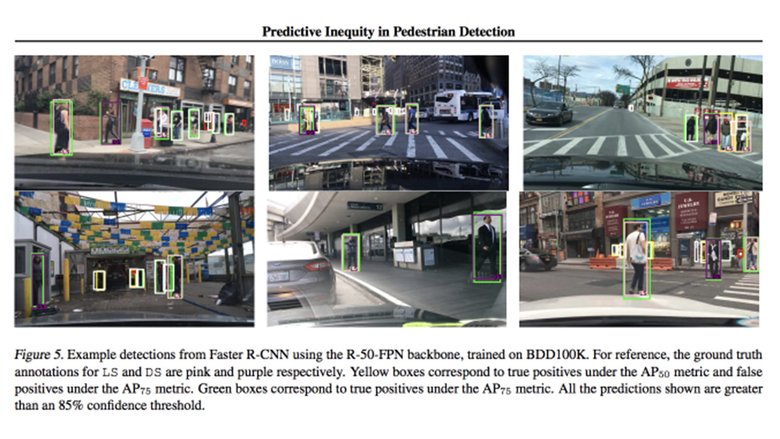

- Руководствуясь Шкалой Фитцпатрика (числовая шкала, основывается на классификации цвета кожи человека), они отсмотрели данные с изображениями пешеходов с моделей обнаружения объектов, подобных тем, что устанавливают в беспилотные авто.

- Дальше подсчитали, как часто модели фиксации на фото выделяли людей. И как часто это были люди со светлым цветом кожи, а как часто – с темным. В итоге определили, что темнокожих алгоритм определял на 5% хуже. Более того, авторы исследования утверждают, что на эти данные не влияет ни время суток на изображениях, ни количество времени, отведенное механизму для анализа.

В конце работы исследователи рекомендуют более внимательно присмотреться к тем системам, которые используются в крупных проектах, если они схожи с теми, о которых говорится в отчете. Сам документ назвали «Предсказываемое неравенство в обнаружении объектов».

Что это за исследование?

А теперь самое интересное. Известный портал Vox взбаламутил своей заметкой всех, хотя исследование на данный момент – сырейший текст, который не проходил даже этапа рецензирования.

В нем исследуются не те модели обнаружения объектов, которые есть в беспилотных автомобилях, а только их аналоги. Изображения, отобранные для анализа, тоже не являются данными, которые есть у тестировщиков беспилотников. Компании не раскрывают такие данные, поэтому пришлось пользоваться общедоступными.

Впрочем, один из коллег ученых написал, что подобные исследования на официальном уровне не опубликовала бы ни одна компания – такое всегда засекречено. А работа исследователей из Джорджии дает понимание отдельных рисков. Главным из них, очевидно, считают влияние человеческого фактора на работу алгоритма. Беспокойство, что искусственный интеллект будет подражать предвзятым взглядам своих создателей.

Портал Vox указывает на несколько громких историй, когда алгоритмы из-за человеческого фактора работали некорректно. В 2015 году система распознавания картинок от Google определяла афроамериканцев как «горилл». В 2018 скандал случился с системой Amazon Rekognition, которая определяет объекты на фото и видео. Она пометила 28 политиков Конгресса как преступников из криминальных сводок, разыскиваемых полицией. Были и другие претензии к другим продуктам: например, распознавание лиц лучше работало со светлокожими людьми, чем с темнокожими. Особенно когда дело касалось женских лиц.

Авторы заявляют, что такое происходит от недостаточно насыщенной программы обучения алгоритма. Он не получает всех необходимых примеров на этом этапе, из-за этого некорректно работает впоследствии. В качестве потенциального предупреждения и решения проблемы предлагается изучать команды ученых, которые работают над алгоритмами. Да, вы правильно поняли, они должны быть максимально разнообразными. Как минимум по расовому признаку.

Что говорят эксперты?

Мы попросили прокомментировать исследование Ольгу Ускову, президента группы компаний Cognitive Technologies. Эта компания занимается как раз беспилотными технологиями.

«Никаких расистских намерений у авторов алгоритмов нейронных сетей не было и нет, – считает Ольга Ускова. – И то, что в экспериментах американских исследователей получился такой результат, на самом деле ничего не значит.

Известно, что результат, который может быть получен на выходе нейронной сети, зависит от условий проведения эксперимента. Может случиться, что в этих условиях освещенности, времени суток, погоды, даже при одинаковых выборках, люди со светлым цветом кожи будут детектироваться [системой] лучше, чем с темным. Так, известно, что обычно светлые автомобили лучше видны, чем темные. Но при ряде условий, например, на заснеженной дороге, ситуация может быть обратной.

То, как ситуацию воспринимает нейронная сеть, ничем не отличается от восприятия человека. Как правило, люди видят лучше светлые предметы на темном фоне, чем темные на темном. И наоборот, темные на светлом, чем светлые на светлом.

Вообще-то, все это прописные истины для разработчиков систем искусственного интеллекта. Авторы исследования, возможно, решили, что большая часть американской и мировой общественности не в курсе этих тонкостей. Вот и решили обратить на себя внимание».

Интересно, что англоязычный твиттер отреагировал на новость довольно противоречиво. В том смысле, что находились люди, пытавшиеся объяснить ситуацию чисто с технической точки зрения:

«Системы визуализации используются в тех ситуациях, когда требуется, чтобы транспортное средство, например, понимало дорожные знаки или аномальные сигналы от радаров и лидаров (эти системы имеют ограничения в неблагоприятных погодных условиях). Кроме того, они обеспечивают дополнительное понимание пространства при маневрах».

«Если бы алгоритмы работали исключительно на основе видео, вся информация исследования была бы возможной. Но все беспилотники (кроме 'Теслы') используют датчики на основе инфракрасных лазеров. То есть, машины не видят человека и его цвет кожи. Они видят кучу точек в форме человека».

Были шутливые реакции:

«Майкл Джексон реально опередил время, сменив цвет кожи»

И попытки обратить внимание на другие проблемы:

«Цветные люди сейчас имеют куда больший процент смертности среди пешеходов. Разрыв куда сильнее, чем проценты в этом исследовании. Как насчет новой статьи об этой широкомасштабной и реально существующей проблеме?»

Еще материалы, которые стоит прочесть: