Что такое DeepFake?

Deep Fake — это технология ИИ, которая позволяет скрестить на видео лицо одного человека с телом другого. Поначалу алгоритм использовали для создания поддельных порно-роликов с участием знаменитостей, а затем юзеры стали подменять физиономии голливудских актеров и мировых политиков.

В конце 2017 года ее разработал пользователь Reddit под ником Deepfakes (отсюда и пошло название). Программист использовал бесплатный гугловский инструмент для работы с машинным обучением TensorFlow и открытую нейросетевую библиотеку Keras.

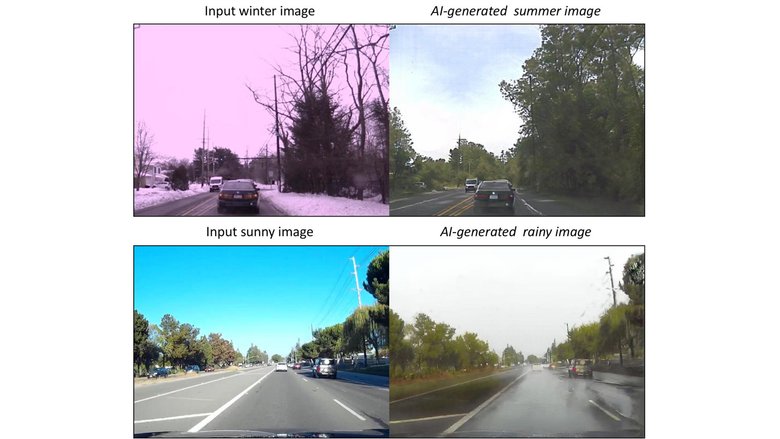

Интересно, что автор нейросети вдохновился разработкой NVIDIA. За несколько месяцев до появления Deep Fake она показала алгоритм, который позволяет полностью менять картинку на видео (в их примере нейросеть научилась превращать летние пейзажи в зимние).

Сейчас нейросеть легко делает вот такие видео:

Первые порноролики

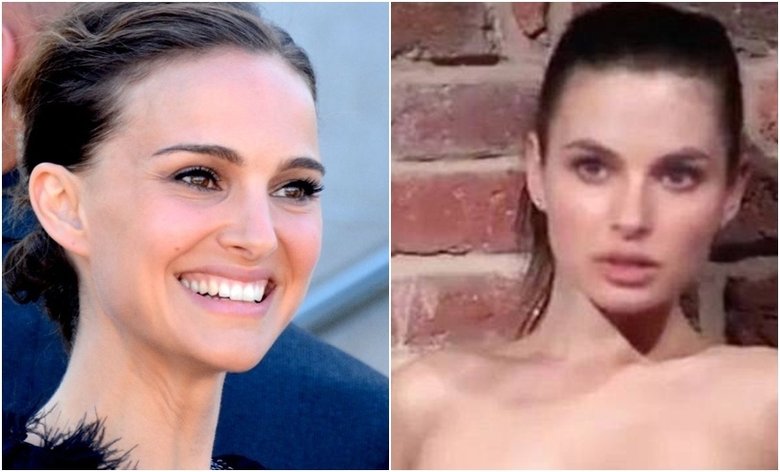

Deppfakes опробовал собственный алгоритм на порно-ролике, в котором якобы снялась известная израильская актриса Галь Гадот (исполнила главную роль в фильме «Чудо-женщина»). Аноним приклеил ее лицо к телу порноактрисы. Результат его настолько впечатлил, что мужчина выложил получившееся видео на Reddit. Позже он пополнил коллекцию эротикой с участием Скарлетт Йохансон, Тейлор Свифт и нескольких других голливудских знаменитостей.

Первые результаты выглядели не слишком правдоподобно: лица звезд периодически мерцали или пропадали, особенно если их носители совершали резкие движения. Однако народу было достаточно и этого.

Подраздел на Reddit в считанные дни набрал около сотни тысяч подписчиков. Из-за такой популярности администрация имиджборда даже ввела для создателей Deep Fake несколько интересных правил. Например, им запрещалось выкладывать поддельные порноролики с лицами несовершеннолетних звезд. По какой-то причине нельзя было делать видео с лицами неизвестных людей.

Народное творчество

Спустя пару месяцев один из юзеров Reddit выложил программу для создания фейков своими руками. Пользоваться ею было гораздо проще, чем разбираться с нейросетями и дополнительными инструментами. К тому же автор пообещал со временем улучшить ее работу до такой степени, чтобы юзеры могли менять лицо актера нажатием одной кнопки — примерно как состарить человека в FaceApp.

Естественно, упрощенный инструмент начал пользоваться бешеной популярностью. Завсегдатаи Reddit моментально бросились плодить новые фейковые ролики с участием звезд. Некоторые из них даже устроили из обычной забавы бизнес: принимали заказы от других на создание порно с определенными актерами. Оплата производилась биткоинами.

Не только порно

На создании порнороликов юзеры останавливаться не собирались. Как только технология стала массово доступна, многие принялись в шутку менять лица актеров в обыкновенных фильмах. Поначалу огромной популярностью пользовался Николас Кейдж — его физиономию приделывали, куда только хватало фантазии: и в фильмы про Джеймса Бонда, и про Супермена, и даже в легендарную «Комнату».

В последнее время жертвами Deep Fake все чаще становятся любимцы зрителей Киану Ривз и Джим Керри — чего стоит хотя бы свежий ролик из кубриковского «Сияния», где Керри вместо Николсона с топором проламывает дверь.

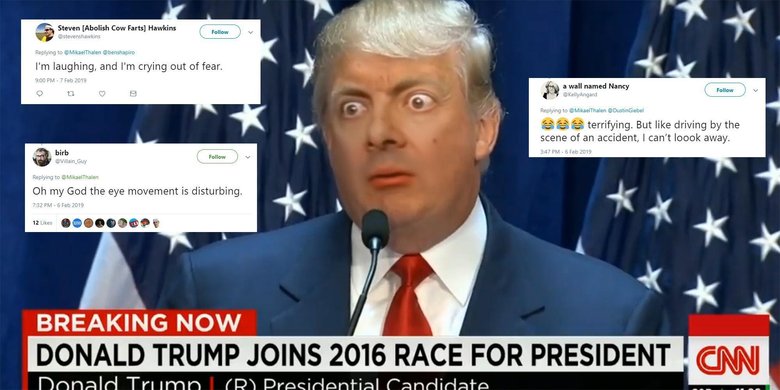

Не менее перспективное направление для использования технологии — политика. Здесь юзеры Reddit тоже успели оторваться на славу. Из самых резонансных примеров: они наклеили лицо Гитлера на президента Аргентины Маурисио Макри, а в дальнейшем скрестили тело Дональда Трампа с лицом Владимира Путина. Получилось достаточно реалистично и даже пугающе.

Не только видео

В июне пользователей сети поразил новый алгоритм DeepNude, который научился «раздевать» девушек на фотографии. Если предыдущий просто заменял лица, то новый самостоятельно перерисовывает тело героини снимка, оставляя ее без одежды. Для этого достаточно было загрузить изображение в программу и несколько секунд подождать.

Как результат — в сети быстро появились фотографии обнаженных звезд. Энтузиасты пробовали «раздеть» и мужчин, но финальные изображения выходили странными, так как алгоритм явно был заточен на прекрасный пол.

Пользователей стало так много, что разработчикам пришлось закрыть доступ к приложению. Они посчитали, что «мир еще не готов» для DeepNude, создатели явно не ожидали такого интереса.

Чем опасны подобные приложения?

Прорывные технологии Deep Fake (и даже DeepNude) могут быть крайне полезны в кинематографе. Но в обычной жизни они таят в себе огромную угрозу сразу по нескольким причинам.

Во-первых, злоумышленники могут создавать фейковые порноролики с «участием» обычных людей, а затем шантажировать их или родственников в интернете. Особенно неприятными последствиями это чревато для детей и подростков, причины объяснять не будем.

Во-вторых, технология Deep Fake может стать серьезным оружием в информационных войнах. Уже сейчас практически невозможно отличить поддельные ролики от настоящих.

Просто представьте ситуацию, в которой лицо какого-нибудь известного политика наклеят на тело обычного оппозиционного гражданина. Последний выскажет все, что думает о ситуации в стране, и разбавит свою речь не самыми красноречивыми эпитетами.

Можно смело предположить, что произойдет дальше. Журналисты-стажеры и интернет-блогеры не будут разбираться в ситуации. Они моментально разнесут фейк по своим СМИ. Такая погоня за трафиком неизбежно приведет к скандалу. Ситуацию спасет только официальное опровержение от реального политика (конечно, если он успеет отреагировать).

Это тоже интересно: